GLM-Realtime是什么

GLM-Realtime是智谱推出的全新端到端多模态模型,具备低延迟的视频理解与语音交互能力,特别融入清唱功能,让大模型在对话中能展现歌唱才能。模型支持长达2分钟的内容记忆以及Function Call功能,支持灵活调用外部知识和工具,拓展应用范围。GLM-Realtime API已经上线智谱开放平台,现阶段可以免费调用,为AI硬件发展提供智能基础,助力开发者实现应用创新。

GLM-Realtime的主要功能

低延迟交互:实现低延迟的视频理解与语音交互,让用户在使用过程中感受到近乎实时的响应,提升交互体验。2分钟内容记忆:在视频通话等场景中,具备长达2分钟的内容记忆能力,能更好地理解和把握对话的上下文,使交互更加连贯、自然。实时打断能力:人类用户能随时打断AI的发言,AI能及时响应这种打断,调整后续的回复或行为。清唱功能:创新性地实现清唱功能,让大模型具备在对话中的歌唱能力。Function Call功能:支持灵活调用外部知识和工具,结合更多的资源和功能,拓展到更广泛的商业场景。视频互动:基于手机或AIPC(人工智能个人计算机)的摄像头,AI能与用户进行视频互动。

GLM-Realtime的项目地址

项目官网:BigModel

GLM-Realtime的应用场景

智能教育:在在线教育平台中,基于视频和语音交互为学生提供个性化的学习辅导,实时解答问题,提升学习效果。智能客服:在企业客户服务中作为视频客服助手,基于视频和语音与客户实时互动,快速准确地解答问题,提高客户满意度。娱乐互动:在虚拟偶像领域,赋予虚拟偶像生动的交互能力,用视频和语音与粉丝互动,增强粉丝的参与感和粘性。智能家居控制:在智能家居系统中,用语音指令和视频理解实现智能家居设备的联动控制,提升家居生活的便利性和舒适度。医疗健康咨询:在远程医疗领域,辅助医生进行远程问诊,用视频观察患者症状,结合语音描述提供诊断建议,提升医疗服务的可及性。

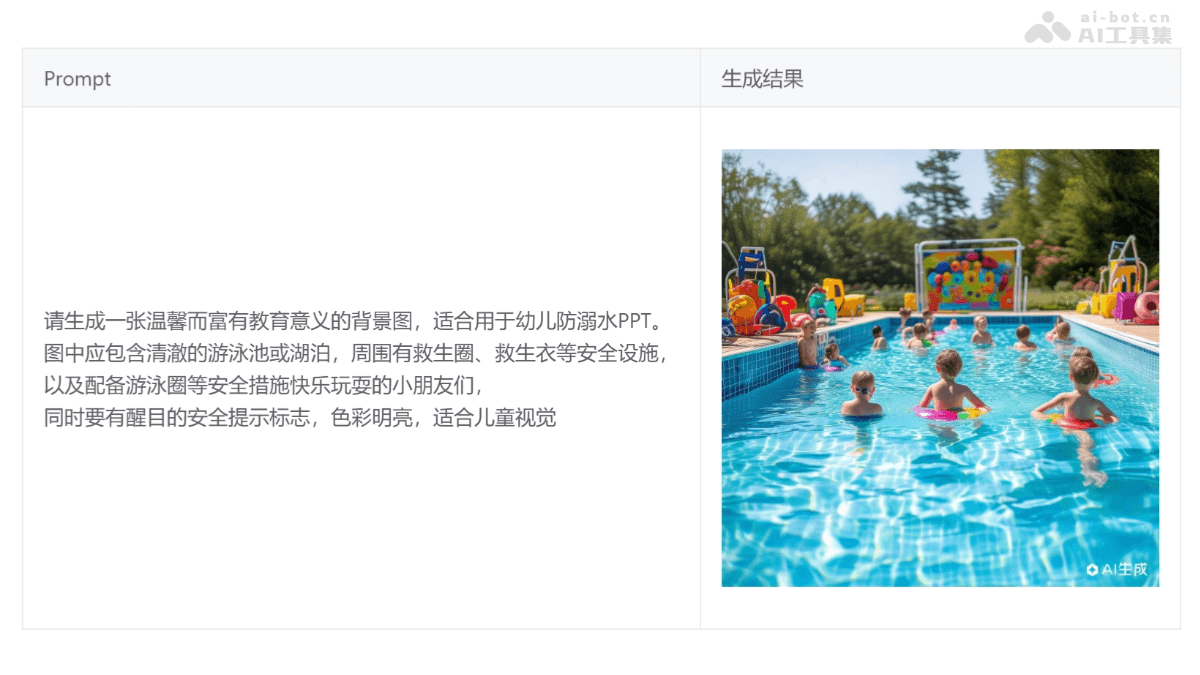

PPT配图

PPT配图